公開日: 2026年2月6日

2024年頃から急速に社会へ浸透した「生成AI」。そして今、その知能がデジタルの画面を飛び出し、現実世界の「身体」を手に入れる「フィジカルAI」の時代が到来しています。

この新しい波「フィジカルAI」について、その定義から製造現場にもたらす変革、そして最新のシステムまでを解説します。

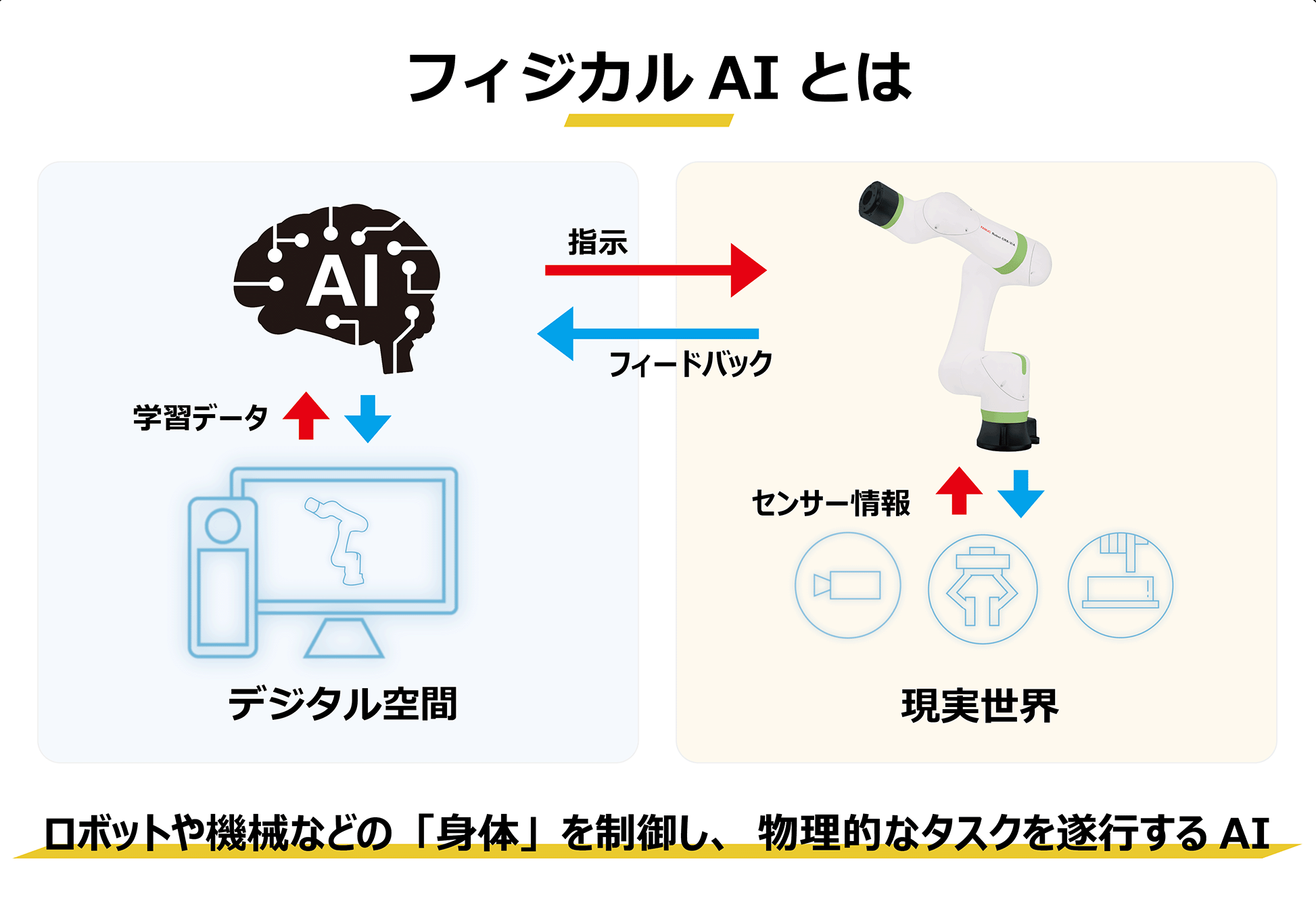

フィジカルAIとは

「フィジカルAI(Physical AI)」とは、デジタル空間のデータ処理だけでなく、現実世界(フィジカル空間)にあるロボットや機械などの「身体」を制御し、物理的なタスクを遂行するAIのことです。

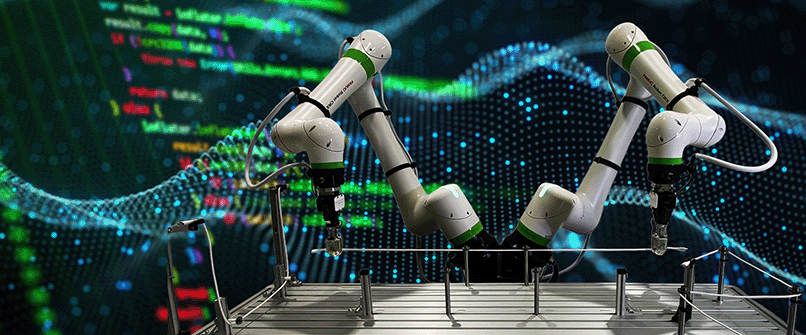

従来のプログラムされたロボットは、決められた動作を正確に再現することが得意でしたが、未知の状況への対応は苦手でした。しかし、フィジカルAIを搭載したロボットは、人間のように「目(センサ)」で状況を認識し、「脳(AI)」で判断し、「身体(ロボティクス)」で行動します。これにより、不定形物の把持や、状況に応じた柔軟な組み立て作業など、これまで自動化が困難だった領域が可能になります。

生成AIとフィジカルAIの違い

生成AIと、フィジカルAIの最大の違いは、アウトプットが「デジタルデータ」か「物理的なアクション」かという点にあります。特にフィジカルAIは、生成AIの「言語理解能力」を指令の解釈に活用しつつ、現実世界での安全で正確な動作を実現するために高度な制御技術を組み合わせています。以下の表で、違いを解説します。

| 生成AI (Generative AI) | フィジカルAI (Physical AI) | |

|---|---|---|

| 主な出力 | テキスト、画像、プログラム、音声 | ロボットアームの動作、移動、把持 |

| 活動場所 | デジタル空間 (サーバー、PC画面内) |

現実空間 (工場、倉庫、物流現場、身の回り) |

| 主な役割 | コンテンツ生成、質問応答、要約 | 物体の操作、組立、搬送、環境への適応 |

| リスク | 情報の誤り(ハルシネーション) | 物理的な衝突、安全性(現実への影響) |

| コア技術 | 大規模言語モデル (LLM) など | 強化学習、ロボティクス、シミュレーション |

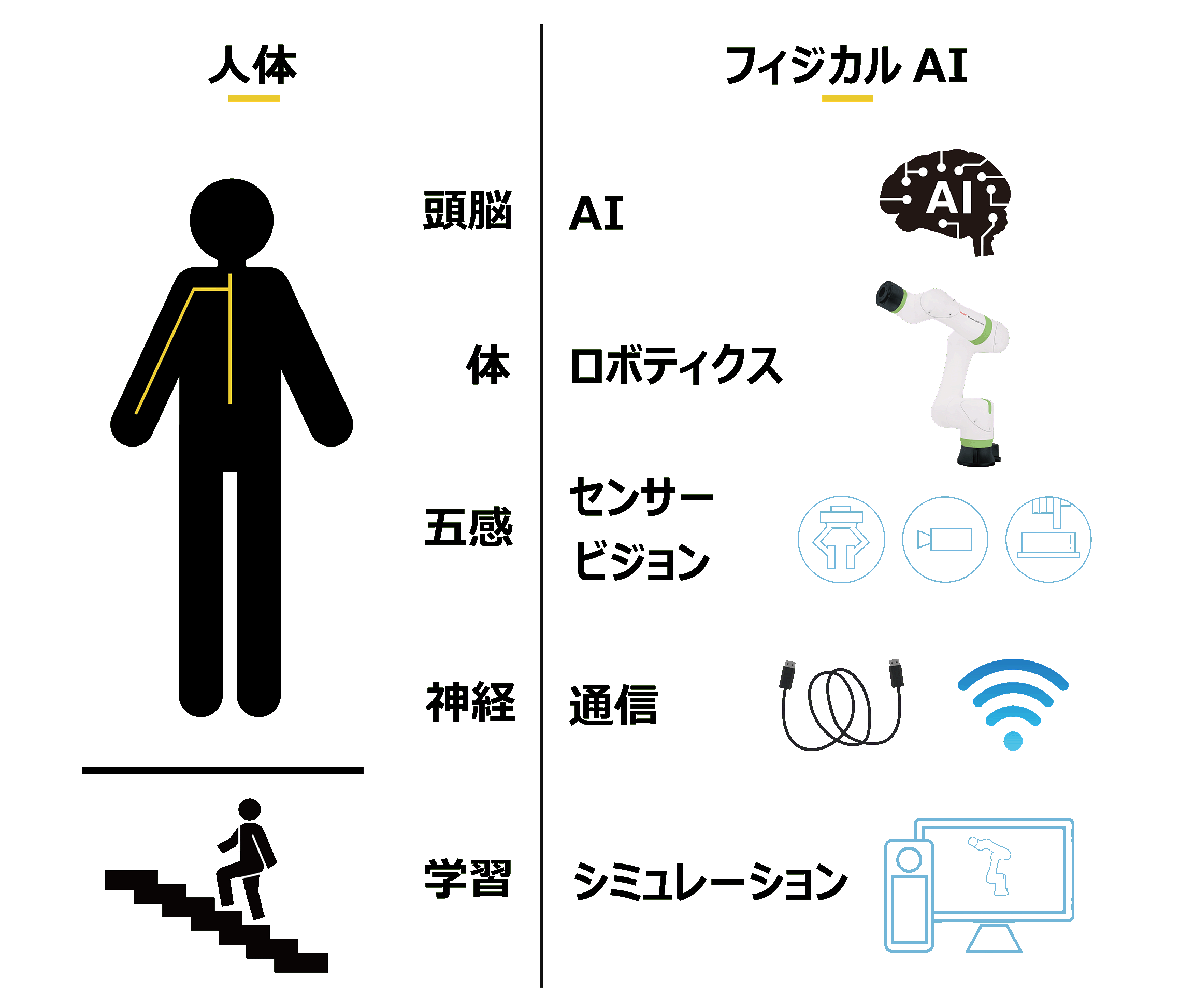

フィジカルAIを支える技術要素

フィジカルAIは、単なるソフトウェアではありません。人間が複雑な作業を行えるのと同じように、5つの要素が有機的に結合し、正確に連動することで初めて機能します。 ここでは、人間の体に例えながら、各5つの要素について解説します。

1. AI(頭脳)

人間の「脳」にあたる部分です。視覚情報や力の加減など周囲のデータを理解し、「次はどう動くべきか」を瞬時に判断します。従来のロボットはプログラムで「AならB」と記述するルールベースが主流でしたが、フィジカルAIでは深層学習(ディープラーニング)や大規模言語モデル(LLM)を活用し、AI自身が状況に応じた最適な解を導き出します。

2. ロボティクス(身体)

人間の「筋肉・骨格」にあたる部分です。AIの判断を実行に移し、重い物を持ち上げたり、繊細に組み立てたりする物理的なアクションを担います。AI(頭脳)が出した高度な指示を正確に実行するためには、強靭で頑丈なロボティクス(身体)が不可欠です。

3. センサーやビジョン(五感)

人間の「目」や「感覚(触覚など)」にあたる部分です。ロボットを取り巻く環境や、対象物の位置・形状・重さなどをリアルタイムに感知します。2D/3Dカメラや力センサーなどがこれに該当し、フィジカルAIが真価を発揮するためには、優れたセンサーの存在が欠かせません。特に照明の変化や振動、粉塵などノイズが多い環境下で、いかに正確な情報を取得できるかが、フィジカルAIの完成度を左右します。

4. 通信(神経)

人間の「神経系」にあたる部分です。フィジカルAIがリアルタイムに状況を把握して行動に移すためには、「センサー(五感)」で得た情報を「AI(頭)」で処理し、その指令を「ロボティクス(身体)」へ遅延なく伝達する必要があります。いかに速い通信に対応できるかが、AIが現実世界で活動するための隠れた重要ポイントとなります。 ファナックでは、高速位置データ通信機能(Stream Motion:ストリームモーション)により、業界最高水準である「1ms(0.001秒)」の超高速通信を実現しました。この技術が、リアルタイムに思考し動作するフィジカルAIの実現を可能にしています。

5. シミュレーション(学習)

人間における「トレーニング・練習」や「経験」にあたる場です。フィジカルAIも生成AIと同様に大量の学習データが必要ですが、体を持つAIである以上、実際の動作結果まで学習する必要があります。しかし、現実世界で物理的な試行錯誤を繰り返すのは、コストや時間が莫大にかかってしまいます。

そこで活用されるのが、仮想空間におけるバーチャルシミュレーションです。仮想空間であれば、現実空間で失敗するリスク(衝突や落下)を負うことなく、何万回もの試行錯誤を繰り返してスキルを習得可能です。

ただし、ここで重要なのは、現実世界を仮想空間に正確に再現する「高度なデジタルツイン」がなければ、学習データを現実世界で活用できないという点です。 この課題に対し、ファナックではNVIDIA Omniverse™ 上で動作する物理シミュレーター「NVIDIA Isaac Sim™」に対応する、正確なロボットモデル「OpenUSD SimReadyアセット」の提供を行っています。

フィジカルAIを支える技術要素

「シミュレーション(学習)」において、特に重要な手法が「強化学習」です。

強化学習とは、AIが試行錯誤を通じて「報酬(成功)」が最大になる行動を自ら学習する方法です。「部品を掴めたらプラスの点数」「落としたらマイナスの点数」といったルールを与えることで、AIは何億回もの試行錯誤を経て、人間も思いつかないような効率的な動きを編み出します。しかし、この技術には「Sim2Real(シム・ツー・リアル)」という大きな壁が存在します。「シミュレーション上ではうまく動いたのに、現実のロボットでは物理法則の誤差や制御のズレで動かない」という問題です。

この壁を突破するため、ファナックではNVIDIAのフォトリアルなシミュレーションプラットフォーム「Isaac Sim」と、自社のロボットシミュレーションソフトウェアである「ROBOGUIDE」を連携させました。「Isaac Sim」が実現するフォトリアルな空間で、「ROBOGUIDE」による実機と同じ制御アルゴリズムでロボットを動かし、一般的なCGシミュレーションでは再現できない「実機と極めて高い精度で一致する軌跡やサイクルタイム」を実現します。 協働ロボット「CRX」から可搬質量2300kgの超大型ロボットまで、ファナックの幅広いラインアップが「OpenUSD SimReadyアセット」として提供されているため、フィジカルAIの開発者は、光の反射や影、素材の質感まで再現するフォトリアルな環境で、ファナックロボットを用いたAI学習データの取得や生成が可能です。

フィジカルAIの活用が期待される分野

フィジカルAIは、現在の技術では自動化が困難とされている分野や、労働力不足という社会課題を解決する切り札として活用が期待されています。ここでは、その一部を紹介します。

製造分野

形状が定まらない「ケーブルやハーネスなどの柔軟物」の組付けや、個体ごとに形が異なる自然物・不定形物の搬送など、従来は人手に頼らざるを得なかった作業への活用が期待されています。また、注文ごとに製品が変わるような極小ロットの現場でも、AIがその都度最適な手順を自ら判断することで、人手による段取り替えを必要としない製造ラインの実現が見込まれています。

物流分野

大型物流倉庫など、商品登録がされていない未知の物体が流れてくる現場においても、フィジカルAIがその形状や重心を瞬時に理解して仕分けを行う「完全ランダムピッキング」が可能になります。さらに、工場から出荷された製品が、自動運転トラックや配送ロボットを経由し、人の手を介さずに直接各家庭へ届く「無人配送ネットワーク」の構築も期待されています。

医療/介護分野

医療分野では、人間の手では不可能なミクロン単位の血管縫合など、「人間の生体限界を超えた精密な手術・処置」に対し、フィジカルAIの活用が期待されています。また介護現場においても、患者の動きや身体状況をリアルタイムに読み取り、適切なタイミングと力加減で補助を行えるロボットの実現が求められています。

救助/危険作業

火災現場や震災時の瓦礫の中、あるいは高放射線エリアなど、人間が立ち入るには危険すぎる環境での活用です。従来の遠隔操作ロボットでは通信遅延や視界不良が課題でしたが、フィジカルAIは足場の悪い不整地でも自律的にバランスを保って歩行し、万が一通信が途切れても、その場で状況を判断して探索や救助活動を継続できるシステムの実現が期待されています。

モビリティ/自動運転

自動運転の分野では、歩行者や他車の動きなど、あらゆる不測の事態をAIが予測・判断し、最適な経路を自律走行する技術が期待されています。ハンドルやブレーキなどの全操作を機械に任せる、究極の自動運転区分「レベル5」の実現が、フィジカルAIが目指す到達点の一つです。

最新のフィジカルAIシステム

ファナックでは、フィジカルAIの実装を加速させるためのオープンプラットフォーム化を推進しています。ここでは、ファナックが実現した4つのフィジカルAIシステムを簡単にご紹介します。

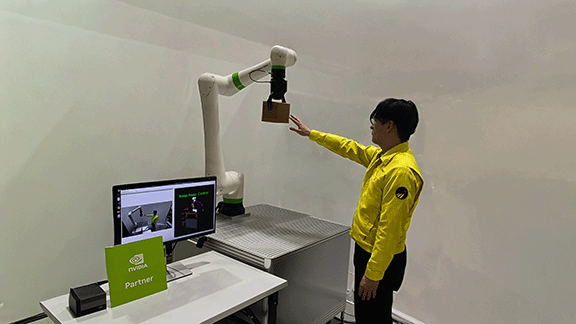

1. 生成AI × ロボット 言葉で操作

プログラミング知識不要で、やりたいことをロボットに伝えるだけで作業が行えるシステムです。生成AIと連携し、例えば「赤いサイコロを振って、出た目の位置にサイコロを置いて」と話しかけるだけで、AIが意図を理解してPythonプログラムを自動生成・実行します。ロボットの「目(カメラ)」が状況を把握しながら動作するため、複雑な命令でも正確に実行します。

2. 人にぶつからないAIロボット

人と接触すると安全に停止する従来の協働ロボットとは異なり、作業を止めずに「避ける」システムです。カメラが周囲を監視し、AIが人の動きに合わせて瞬時に回避ルートを計算。生産性を落とさずに安全を確保します。人が離れれば即座に元の軌道へ自動で復帰します。

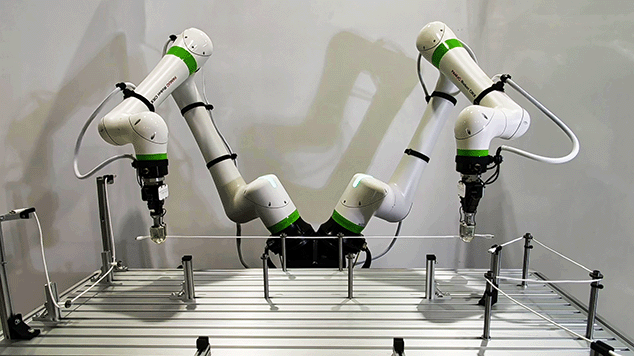

3. アーム2本で柔らかケーブルを配線

自動化が困難だった「柔軟物」の扱いを、2本のアームの協調動作で実現しました。高度な力制御により、人手で行っていた作業のように、ケーブルの張りをリアルタイムに感じ取り、引っ張りすぎないよう絶妙な力加減で調整しながら、配線作業を行います。

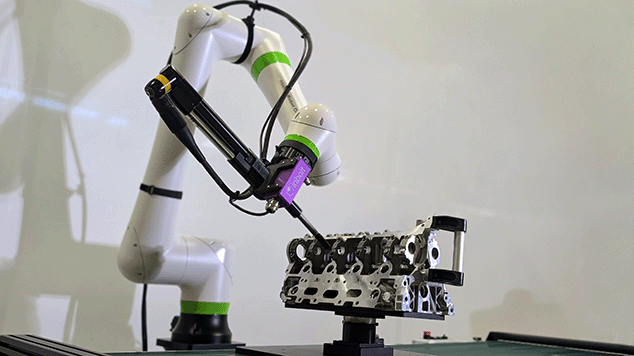

4. 動く部品を追いかけ、ねじ締め

流れる部品を止めずに作業する技術を、3次元空間で実現します。位置や向きが変わりながら流れてくるワークをAIが3次元的に認識し、手先をピタリと同期させます。単に追従するだけでなく、動きながら「一定トルクでのねじ締め」のような精密動作が可能。ロボットでハンドリングを行っている最中など、ワークが複雑に動く環境でも追従し作業ができます。

フィジカルAIで生活を豊かに

フィジカルAIは、単なる効率化のツールではありません。危険な作業や過酷な環境での労働から人間を解放し、人手不足により運用維持が難しくなりつつある製造や物流のインフラを守るための切り札です。「デジタルな頭脳(AI)」と「強靭なフィジカル(身体)」が融合することで、私たちの生活はより豊かで、持続可能なものへと進化していくでしょう。

ファナックで実現する、次世代の「フィジカルAI」

ファナックでは、フィジカルAIの開発をサポートするべく、オープンプラットフォームへの対応を強化しています。近年のロボット開発には欠かせない、ROS 2ドライバのソースコードをGitHubにて公開。このドライバは業界最高水準の1ms超高速制御を実現し、緻密なAI制御の実装を可能にします。さらに、協働ロボット CRXシリーズ に加え、可搬質量3kg~2300kgの幅広いファナックロボットに対応。高い信頼性と柔軟性を兼ね備えています。GitHub上では、公式サポートによる問い合わせ対応を提供し、過去の問合せ対応も参照可能です。開発者コミュニティとの連携を強化し、よりスムーズなロボット開発を支援します。

「最新のAI研究をファナックのロボットで実証したい」 「ROS 2を活用した具体的なシステム構成について相談したい」このようなご要望をお持ちの方は、ぜひ以下のリンクより詳細をご確認ください。

* ROS はOpen Source Robotics Foundationの商標です。

** Python はPython Software Foundationの登録商標です。

*** GitHubはGitHub, Inc.の登録商標です。

**** Visual Studio Code、VSCodeは、Microsoft Corporationの商標です。